본 포스팅은 LangSmith의 공식 기술 문서를 바탕으로 데이터 관리, 접근 제어, 확장성, 그리고 하이브리드 및 셀프 호스팅 배포 환경에서의 플랫폼 설정 방안을 정리한 내용을 포함합니다.

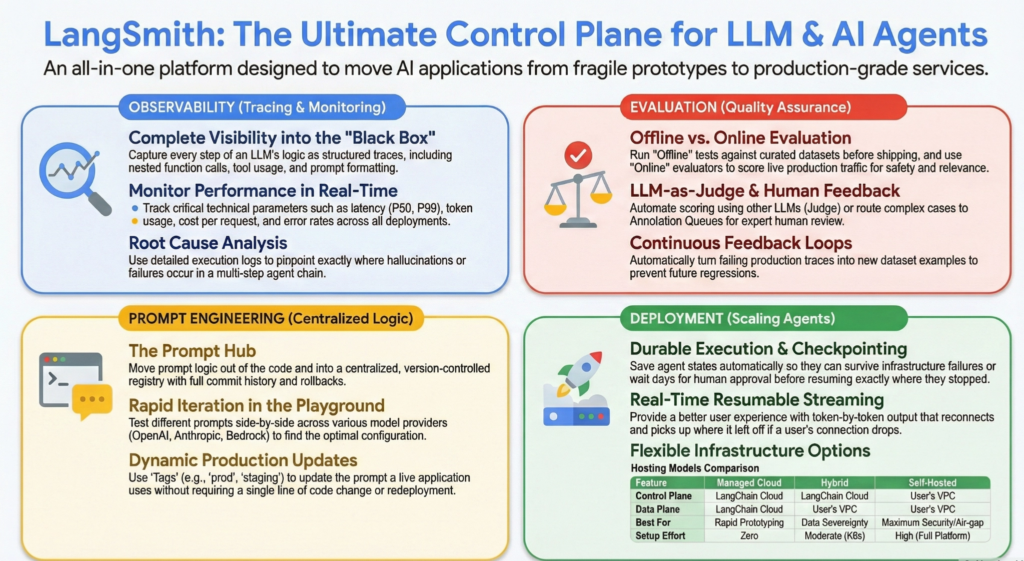

거대 언어 모델(LLM)이 비즈니스의 핵심 동력으로 자리 잡으면서, 기업들은 단순한 모델 호출을 넘어 복잡한 ‘에이전트’ 시스템을 구축하고 있습니다.

그러나 에이전트가 자율적으로 판단하고 도구를 사용하는 과정은 종종 ‘블랙박스’와 같아서, 내부에서 어떤 일이 벌어지는지 파악하기 어렵습니다.

운영 팀은 “왜 이 에이전트가 예기치 않은 답변을 내놓았는가?”, “성능 저하의 원인은 모델인가, 아니면 외부 API인가?”, “민감한 데이터가 안전하게 격리되어 있는가?”와 같은 복합적인 질문에 직면하게 됩니다.[1, 2]

LangSmith는 이러한 불확실성을 해소하기 위해 설계된 통합 플랫폼으로, 에이전트의 전 생애주기를 관리하고 가시성을 확보하는 데 결정적인 역할을 수행합니다.

LangSmith의 요금제 설명은 아래 페이지 참고해주세요

LangSmith의 데이터 관리 및 보존 전략

리소스 계층 구조를 통한 논리적 데이터 격리

LangSmith의 데이터 관리는 조직(Organization), 워크스페이스(Workspace), 애플리케이션(Application), 리소스(Resources)라는 네 가지 핵심 계층을 통해 이루어집니다.[3]

조직은 가장 상위의 논리적 그룹으로, SSO 설정, 과금 통합 관리, 전사적 사용량 추적을 담당합니다.[3, 4]

그 아래의 워크스페이스는 팀이나 부서 단위의 물리적·논리적 격리를 제공하며, 각 워크스페이스는 자체적인 트레이싱 프로젝트, 데이터셋, 프롬프트를 보유합니다.[3, 4]

이러한 구조는 대규모 엔터프라이즈 환경에서 부서 간 데이터 간섭을 방지하고, 리소스 태그(Resource Tags)를 통해 속성 기반 접근 제어(ABAC)를 실현하는 기반이 됩니다.[3]

LangSmith 티어별 데이터 보존 정책과 비용 최적화

트레이스 데이터의 보존은 운영 비용과 규제 준수 사이의 균형을 맞추는 핵심 요소입니다.

LangSmith는 두 가지 기본 보존 티어를 제공합니다.

Base 티어는 데이터를 14일간 보존하며, 주로 단기 디버깅이나 대량의 테스트 실행에 활용됩니다.[3, 5]

반면 Extended 티어는 데이터를 400일간 보존하여 장기적인 성능 추적과 감사(Audit)를 가능하게 합니다.[3]

특히, 특정 피드백이 추가되거나 자동화 규칙에 매칭되는 트레이스는 시스템에 의해 자동으로 Extended 티어로 업그레이드되어 중요한 데이터가 유실되지 않도록 보장합니다.[3]

| 데이터 구분 | 보존 기간 | 주요 용도 | 과금 특징 |

|---|---|---|---|

| Base Traces | 14일 | 단기 디버깅, 개발 단계 테스트 | 저비용 (0.05센트/Trace) [3] |

| Extended Traces | 400일 | 운영 모니터링, 장기 분석, 규제 준수 | 고비용 (0.50센트/Trace) [3] |

| Datasets | 무기한 | 모델 훈련, 골든셋 관리, 성능 벤치마킹 | 보존 기간 제한 없음 [3] |

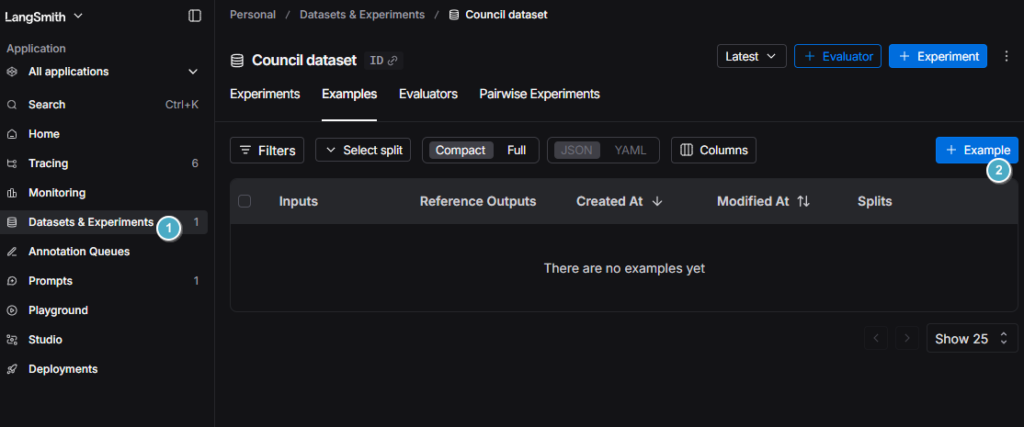

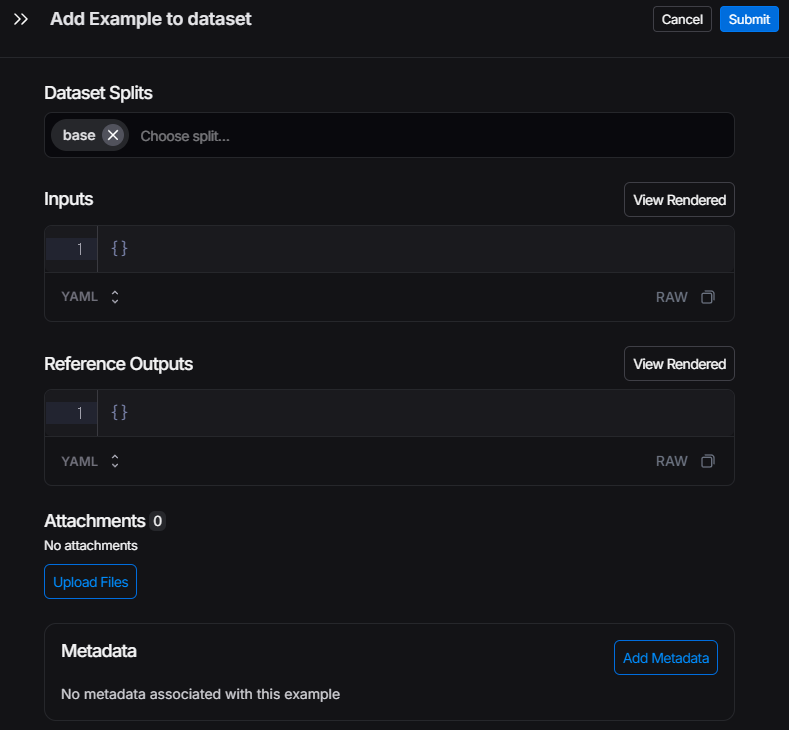

데이터셋을 활용한 영구 데이터 자산화

일반적인 트레이스는 설정된 보존 기간이 지나면 삭제되지만, 데이터셋(Datasets)에 포함된 입력과 출력 쌍은 영구적으로 보존됩니다.[3]

이는 기업이 시간이 지남에 따라 가치 있는 골든셋(Golden Set)을 축적하고, 이를 모델 미세 조정(Fine-tuning)이나 회귀 테스트(Regression Testing)에 재활용할 수 있게 합니다.[3, 6]

따라서 운영 중에 발견된 유의미한 사례나 실패한 케이스는 즉시 데이터셋으로 전환하여 자산화하는 전략이 권장됩니다.

LangSmith의 역할 기반 접근 제어 및 보안 아키텍처

조직 수준의 관리 권한 정의

보안은 접근 권한의 세밀함에서 시작됩니다.

LangSmith는 조직 수준에서 세 가지 고정 역할을 제공합니다.[4]

Organization Admin은 조직의 모든 설정, SSO 구성, 과금 관리 및 워크스페이스 생성 권한을 가집니다.[4]

Organization User는 조직 정보를 읽고 개인 액세스 토큰(PAT)을 생성할 수 있지만, 관리 설정 변경은 불가능합니다.[4]

Organization Viewer는 가장 제한적인 권한으로, 정보를 읽을 수만 있고 토큰 생성조차 제한된다.[4]

이러한 역할 분담은 관리 책임의 소재를 명확히 하고 권한 남용의 위험을 줄인다.

워크스페이스 RBAC와 사용자 정의 역할

엔터프라이즈 플랜에서 제공되는 워크스페이스 RBAC는 더욱 세밀한 제어를 가능하게 합니다.[3, 4]

워크스페이스 내에서 사용자는 Admin, Editor, Viewer 중 하나의 역할을 부여 받습니다.[4]

특히 Editor 역할은 대부분의 리소스를 관리할 수 있으면서도 실행 기록(Run)의 삭제나 멤버 관리 권한은 제외되어 있어, 일반적인 개발 및 운영 인력에게 적합합니다.[4]

엔터프라이즈 고객은 이러한 기본 역할 외에도 특정 권한 조합을 가진 커스텀 역할(Custom Roles)을 생성하여 비즈니스 워크플로우에 최적화된 보안 체계를 구축할 수 있습니다.[4]

| 워크스페이스 역할 | 리소스 생성/수정 | 리소스 삭제 | 멤버 및 설정 관리 |

|---|---|---|---|

| Workspace Admin | 가능 | 가능 | 가능 |

| Workspace Editor | 가능 | 제한됨 (런 삭제 불가) [4] | 불가 |

| Workspace Viewer | 불가 (읽기 전용) | 불가 | 불가 |

API 인증 및 키 관리 전략

시스템 간 통신과 프로그래밍 방식의 접근을 위해 LangSmith는 API Key와 개인 액세스 토큰(PAT)을 사용합니다.[3]

보안 강화를 위해 API Key 생성 시 만료 날짜를 설정하는 것이 권장되며, 만료된 키는 즉시 무효화되어 재활성화가 불가능합니다.[3]

또한, 셀프 호스팅 환경에서는 apiKeySalt와 같은 비밀 키를 생성하여 API Key의 무결성을 보장하며, JWT Secret을 통해 기본 인증(Basic Auth)의 보안성을 높입니다.[7]

확장성 및 복원력 설정

수평적 확장을 위한 무상태 서버 설계

LangSmith 아키텍처의 핵심은 모든 서비스 인스턴스가 무상태(Stateless)로 동작한다는 점입니다.[8]

서버 인스턴스들은 메모리에 리소스를 유지하지 않으며, 로드 밸런서를 통해 트래픽을 공유합니다.[8]

Redis PubSub을 통해 인스턴스 간 통신이 이루어지므로 세션 고정(Session Stickiness)이 필요 없으며, 이는 트래픽 증가 시 인스턴스를 단순히 증설하는 것만으로도 선형적인 성능 향상을 가능하게 합니다.[8]

데이터베이스 복원력 및 장애 복구 로직

고가용성 확보를 위해 LangSmith는 하드웨어 장애나 인프라 중단 상황에 대비한 복구 메커니즘을 갖추고 있습니다.[8]

실행 중인 작업은 Redis에 하트비트(Heartbeat)를 기록하며, 서버가 중단될 경우 2분마다 실행되는 스위퍼(Sweeper) 작업이 이를 감지하여 중단된 작업을 큐에 다시 투입합니다.[8]

또한 PostgreSQL은 다중 가용 영역(Multi-AZ) 복제를 통해 자동 장애 조치(Failover)를 지원하며, 데이터가 손실되지 않도록 동기 커밋 방식을 채택합니다.[8, 9]

부하량에 따른 인프라 사이징 가이드

성능 최적화를 위해 조직의 사용량에 맞춘 적절한 리소스 할당이 필요합니다. [10]

| 트래픽 수준 | 초당 트레이스 수 | 백엔드 복제본 수 | 권장 Redis 자원 | 권장 ClickHouse 자원 |

|---|---|---|---|---|

| Low | 10 미만 | 2개 | 8 Gi | 4 CPU, 16 Gi |

| Medium | 100 미만 | 16개 | 13 Gi (외부 관리) | 16 CPU, 24 Gi |

| High | 1000 미만 | 50개 | 26 Gi (외부 관리) | 14 CPU, 24 Gi (3노드 클러스터) |

특히 ClickHouse는 분석의 핵심이므로, 읽기 성능 향상을 위해 고성능 SSD 스토리지 클래스(최소 7000 IOPS, 1000 MiB/s) 사용이 강력히 권장됩니다.[7, 10]

추적 관측성

트레이싱과 런의 구조적 이해

LangSmith의 관측성은 애플리케이션의 동작을 ‘트레이스(Trace)’와 ‘런(Run)’이라는 단위로 구조화하여 보여줍니다.[1, 11]

트레이스는 전체 요청 시퀀스를 의미하며, 런은 그 내부의 개별 작업(LLM 호출, 도구 사용, 프롬프트 포맷팅 등)을 나타냅니다.[2, 11]

이러한 계층적 구조는 에이전트가 복잡한 판단을 내리는 과정에서 어느 단계가 지연을 유발하는지, 혹은 어느 도구가 잘못된 출력을 내놓는지 정확하게 짚어낼 수 있게 합니다.[2]

실시간 모니터링과 알림 체계

운영 환경에서의 가시성을 위해 LangSmith는 실시간 성능 대시보드를 제공합니다.

여기서는 지연 시간(P50,P99), 토큰 사용량에 따른 비용, 오류율, 사용자 피드백 점수 등을 추적할 수 있습니다.[1, 2]

p50 latency : 전체 요청 중 50%가 이 시간 이하로 응답

p99 latency : 전체 요청 중 99%가 이 시간 이하로 응답

특히 온라인 평가기(Online Evaluators)를 설정하면 실시간으로 유해성 검사나 형식 검증을 수행하고, 임계치를 넘는 이상 징후 발생 시 웹훅(Webhook)이나 PagerDuty를 통해 즉각적인 알림을 보낼 수 있습니다.[1, 6]

OpenTelemetry(OTel) 통합 및 표준화

LangSmith는 산업 표준인 OpenTelemetry를 지원하여 기존 인프라와의 연동성을 극대화합니다.[1, 11]

OTel 계측 데이터는 LangSmith SDK를 사용하지 않는 애플리케이션에서도 트레이스 정보를 수집할 수 있게 하며, 수집된 데이터는 https://api.smith.langchain.com/otel/v1/traces와 같은 엔드포인트를 통해 전송됩니다.[11]

이는 분산 트레이싱 환경에서 LLM 애플리케이션이 차지하는 위치를 전체 시스템 관점에서 조망할 수 있게 합니다.

OpenTelemetry?

애플리케이션 내부 상태를 표준 방식으로 수집해 외부 모니터링 시스템으로 보내는 관측 인프라

벤더 종속서을 제거 했으며 MSA 환경에서 필수적인 모니터링 체계를 제공해줌

정량적 품질 관리

오프라인 평가 및 회귀 테스트 루프

새로운 프롬프트나 모델을 배포하기 전, 품질 저하를 막기 위한 오프라인 평가는 필수적입니다.[6]

과정은 데이터셋 생성에서 시작하여, 에이전트를 해당 데이터셋에서 실행하고, 정의된 평가기(Evaluator)를 통해 결과를 채점하는 방식으로 진행됩니다.[6]

평가기는 인간의 직접 검수뿐만 아니라, 결정론적인 코드 규칙, 그리고 ‘LLM-as-judge’ 방식을 모두 포함합니다.[6, 12]

이를 통해 개발자는 성능 지표의 변화를 수치로 확인하고 배포 여부를 결정할 수 있습니다.

온라인 평가와 피드백 루프의 구축

운영 환경에서의 실시간 평가는 모델의 드리프트(Drift)나 예상치 못한 에지 케이스를 발견하는 데 사용됩니다.[6, 12]

온라인 평가기는 라이브 트래픽에 대해 참조 데이터 없이 품질 휴리스틱이나 안전성 검사를 수행합니다.[6]

여기서 발견된 실패 사례는 자동으로 다시 데이터셋에 추가되어 오프라인 평가의 기반이 되는 선순환 피드백 루프를 형성합니다.[6]

| 평가 유형 | 실행 시점 | 주요 특징 | 평가 도구 |

|---|---|---|---|

| Offline | 배포 전 (CI/CD) | 참조 답변(Ground Truth) 활용, 정밀 분석 | 코드 규칙, 회귀 테스트, 인간 채점 |

| Online | 배포 후 (실시간) | 라이브 데이터 활용, 실시간 모니터링 | 품질 휴리스틱, 안전성 검사, 샘플링 채점 |

인간 피드백과 주석 큐(Annotation Queues)

자동화된 평가기가 모든 것을 잡아낼 수는 없습니다.

LangSmith는 주석 큐를 통해 도메인 전문가가 트레이스를 검토하고 정확한 피드백을 남길 수 있는 환경을 제공합니다.[6, 12]

공유된 채점 기준을 바탕으로 다수의 검수자가 일관된 피드백을 제공할 수 있으며, 이 데이터는 다시 자동 평가기를 튜닝하거나 모델의 미세 조정 데이터로 활용됩니다.[6, 12]

프롬프트 엔지니어링 및 협업

중앙 집중식 프롬프트 허브와 버전 관리

프롬프트는 더 이상 코드에 하드코딩된 문자열이 아니라 독립적으로 관리되어야 하는 자산입니다.[13]

LangSmith Prompt Hub는 조직 내에서 프롬프트를 공유하고 버전 관리하는 중앙 저장소 역할을 합니다.[14, 15]

모든 변경 사항은 커밋(Commit)으로 기록되어 변경 이력을 추적할 수 있으며, 이전 버전으로의 즉각적인 롤백이 가능합니다.[14]

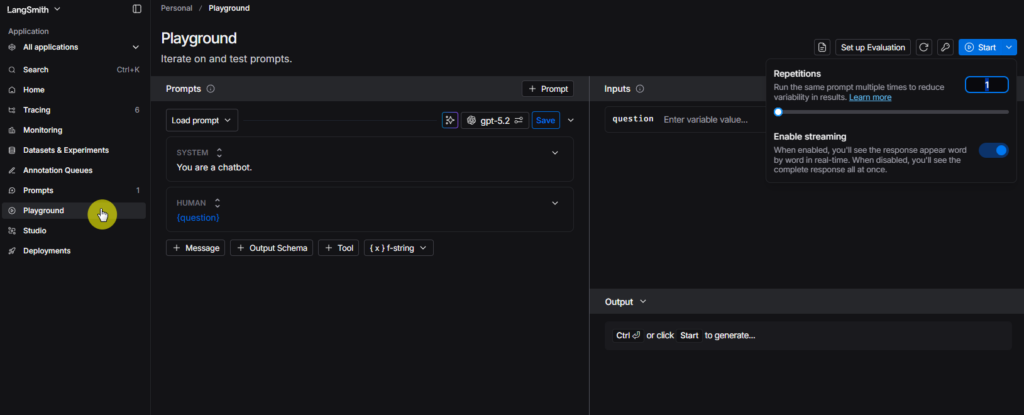

플레이그라운드와 Polly AI를 통한 실험 가속화

프롬프트 플레이그라운드는 UI 상에서 다양한 모델과 매개변수를 사용하여 프롬프트를 즉석에서 테스트할 수 있는 환경을 제공합니다.[13, 14]

여기에 포함된 Polly AI 어시스턴트는 프롬프트를 자동으로 최적화하거나, 적절한 출력 스키마를 생성하고 도구 호출 로직을 보완하는 등 인공지능 기반의 엔지니어링 지원을 제공합니다.[14, 15]

LangSmith Polly AI

목적: AI 에이전트의 디버깅, 성능 분석, 프롬프트 엔지니어링 자동화

역할 : Polly는 AI가 그 로그들을 대신 읽고 어디서 실수가 있었는지, 어떻게 개선할지 알려주는 “메타 AI

복잡한 AI 에이전트(예: LangGraph로 구축된 다단계 봇)는 실행 한 번에 수백 개의 단계를 거치기도 하는데, 사람이 이를 일일이 확인하는 것은 불가능에 가깝습니다. Polly는 이 과정을 자연어로 돕습니다.

LangSmith PlayGround

LangSmith의 **플레이그라운드(Playground)**는 개발자가 작성한 프롬프트를 실제 AI 모델에 보내기 전에, 웹 인터페이스에서 실시간으로 테스트하고 튜닝할 수 있는 실험실입니다.

버전 관리: 수정된 프롬프트를 ‘프롬프트 허브(Prompt Hub)’에 저장하여 코드에서 불러다 쓸 수 있게 연결합니다.

모델 독립성: OpenAI(GPT), Anthropic(Claude), Google(Gemini) 등 다양한 모델을 한곳에서 교체하며 성능을 비교할 수 있습니다.

동적 배포를 위한 태그(Tag) 시스템

코드 수정 없이 프롬프트를 업데이트하기 위해 LangSmith는 태그 시스템을 활용합니다.[14]

예를 들어, 코드에서는 prod라는 태그를 참조하도록 설정하고, 플레이그라운드에서 프롬프트를 개선한 뒤 prod 태그가 최신 커밋을 가리키도록 변경하면, 실행 중인 애플리케이션은 즉시 새로운 프롬프트를 사용하게 됩니다.[14]

이는 배포 주기와 프롬프트 실험 주기를 분리하여 운영 효율성을 높입니다.

LangSmith Deployment: 에이전트 인프라 운영

Agent Server의 지속적 실행과 상태 관리

에이전트 배포를 위한 LangSmith Deployment(구 LangGraph Platform)는 장시간 실행되는 워크로드를 위해 특화된 기능을 제공합니다.[16, 17]

특히 체크포인팅(Checkpointing) 기능을 통해 에이전트의 상태를 저장함으로써, 실행 중 오류가 발생하더라도 처음부터가 아닌 중단 지점부터 재개할 수 있습니다.[17]

이는 인간의 승인을 기다리는 인터럽트(Interrupt) 워크플로우나 예약된 크론(Cron) 작업을 안정적으로 수행하게 합니다.[17]

수평적 확장과 작업 큐(Task Queue) 아키텍처

대규모 트래픽을 처리하기 위해 Deployment 시스템은 작업 큐 기반의 아키텍처를 채택합니다.[16, 18]

KEDA를 활용하여 큐에 쌓인 대기 작업 수에 따라 워커 노드를 자동으로 확장하며, 각 작업은 무상태 서버 내의 백그라운드 워커 풀에 의해 처리됩니다.[18, 19]

통신은 Redis PubSub을 통해 실시간 스트리밍 출력을 지원하며, 이는 사용자에게 토큰 단위의 빠른 응답 경험을 제공합니다.[18]

CI/CD 파이프라인과 미리보기 배포

신뢰성 있는 에이전트 운영을 위해 현대적인 CI/CD 통합이 지원됩니다.[20]

PR이 생성되면 자동으로 미리보기 배포(Preview Deployment)가 생성되어 개발자가 라이브 환경에서 기능을 검증할 수 있으며, 테스트를 통과한 코드만 본 프로젝트에 병합되어 프로덕션 버전으로 업데이트 됩니다.[20, 21, 22]

플랫폼 설정 및 인프라 구축 전략

하이브리드 배포 모델

하이브리드 모드는 데이터 주권과 관리 편의성 사이의 최적의 절충입니다.[23]

제어부(UI, 관리 API)는 LangChain의 클라우드에서 호스팅되지만, 실제 에이전트가 실행되고 데이터가 저장되는 데이터부(Data Plane)는 고객의 클라우드 인프라 내에 위치시킵니다.[23, 24]

- 리스너(Listener) 설정:

- 데이터부에는 제어부의 변경 사항을 폴링하는 리스너 애플리케이션이 설치됩니다.[19]

- 리스너는 조직 ID와 워크스페이스 ID로 인증하며, 쿠버네티스 네임스페이스를 감시하여 배포를 오케스트레이션합니다.[19]

- 네트워킹 요구사항:

- 데이터부는

api.host.langchain.com등에 대한 HTTPS 에그레스 권한이 필요합니다.[19, 23] - 또한, 인그레스 구성을 위해 현대적인 Gateway API나 Istio Gateway 사용이 강력히 권장됩니다.[19, 25]

- 데이터부는

셀프 호스팅 배포 모델

완전 폐쇄형 환경이 필요한 기업을 위해 LangSmith는 전체 플랫폼의 셀프 호스팅을 지원합니다.[9, 24]

이는 쿠버네티스 환경에서 Helm 차트를 통해 설치되며, 모든 데이터베이스(Postgres, Redis, ClickHouse)를 고객이 직접 관리합니다.[7]

- 인프라 요건: 최소 16 vCPU와 64GB 메모리가 권장되며, ClickHouse 가용성을 위해 전용 노드 풀 구성이 권장됩니다.[7]

- 클라우드 최적화: AWS(EKS, RDS, S3), GCP(GKE, Cloud SQL, GCS), Azure(AKS, Managed Redis, Blob Storage) 등 각 벤더의 관리형 서비스를 백엔드로 연결하여 운영 부담을 줄일 수 있습니다.[9, 21, 22]

| 배포 방식 | 제어부 관리 | 데이터부 관리 | 데이터 저장소 | 권장 상황 |

|---|---|---|---|---|

| Managed Cloud | LangChain | LangChain | LangChain Cloud | 빠른 시작, 관리 부담 최소화 |

| Hybrid | LangChain | 고객 (VPC) | 고객 VPC (실행 데이터) | 데이터 보안 + 관리 편의성 |

| Self-Hosted | 고객 (VPC) | 고객 (VPC) | 고객 VPC (전체) | 최고 수준 보안, 에어갭 환경 |

인그레스 및 외부 통신 설정의 핵심

셀프 호스팅이나 하이브리드 환경에서 가장 중요한 것은 안정적인 진입점(Ingress) 확보입니다.[25]

LangSmith는 v0.12.0부터 Gateway API를 공식 지원하며, 이를 통해 여러 네임스페이스에 걸친 에이전트 배포를 효율적으로 관리할 수 있습니다.[25, 26]

또한, 라이선스 검증과 사용량 보고를 위해 beacon.langchain.com으로의 아웃바운드 통신이 필요하며, 보안상 이를 차단해야 하는 경우 오프라인 모드에 대한 별도 협의가 필요합니다.[7, 11]

종합적으로 볼 때, LangSmith는 단순한 도구가 아니라 엔터프라이즈 AI 에이전트의 ‘운영 체제’와 같은 역할을 수행합니다.

데이터의 논리적 격리부터 고가용성 인프라 구축, 그리고 지속적인 품질 평가 루프에 이르기까지, LangSmith가 제공하는 아키텍처를 올바르게 활용함으로써 기업은 신뢰할 수 있고 확장 가능한 인공지능 서비스를 실현할 수 있습니다.

인프라 설계 시에는 관리형 서비스의 활용을 극대화하고, 데이터 보존 정책을 통해 비용 효율성을 확보하며, RBAC를 통해 최소 권한 원칙을 준수하는 것이 성공적인 운영의 핵심입니다. [1, 6, 7, 9, 24]

Reference

- AI Agent & LLM Observability Platform – LangSmith – LangChain, https://www.langchain.com/langsmith/observability

- A Practical Guide to Tracing and Evaluating LLMs Using LangSmith | ADaSci Blog, https://adasci.org/blog/a-practical-guide-to-tracing-and-evaluating-llms-using-langsmith

- Overview – Docs by LangChain, https://docs.langchain.com/langsmith/administration-overview

- Role-based access control – Docs by LangChain, https://docs.langchain.com/langsmith/rbac

- LangSmith Plans and Pricing – LangChain, https://www.langchain.com/pricing

- LangSmith Evaluation – Docs by LangChain, https://docs.langchain.com/langsmith/evaluation

- Self-host LangSmith on Kubernetes – Docs by LangChain, https://docs.langchain.com/langsmith/kubernetes

- Scalability & resilience – Docs by LangChain, https://docs.langchain.com/langsmith/scalability-and-resilience

- Self-hosted LangSmith on Azure – Docs by LangChain, https://docs.langchain.com/langsmith/azure-self-hosted

- Configure LangSmith for scale – Docs by LangChain, https://docs.langchain.com/langsmith/self-host-scale

- TrueFoundry AI Gateway and LangSmith: Building Observable, Evaluated AI Systems, https://www.truefoundry.com/blog/truefoundry-ai-gateway-integration-with-langsmith

- LangSmith – LLM & AI Agent Evals Platform: Continuously improve agents – LangChain, https://www.langchain.com/langsmith/evaluation

- Prompt engineering quickstart – Docs by LangChain, https://docs.langchain.com/langsmith/prompt-engineering-quickstart

- Prompt engineering concepts – Docs by LangChain, https://docs.langchain.com/langsmith/prompt-engineering-concepts

- Prompt engineering – Docs by LangChain, https://docs.langchain.com/langsmith/prompt-engineering

- LangSmith: Agent Deployment Infrastructure for Production AI Agents – LangChain, https://www.langchain.com/langsmith/deployment

- LangSmith Deployment – Docs by LangChain, https://docs.langchain.com/langsmith/deployments

- LangSmith data plane – Docs by LangChain, https://docs.langchain.com/langsmith/data-plane

- Set up hybrid LangSmith – Docs by LangChain, https://docs.langchain.com/langsmith/deploy-hybrid

- Implement a CI/CD pipeline using LangSmith Deployment and Evaluation – Docs by LangChain, https://docs.langchain.com/langsmith/cicd-pipeline-example

- Self-hosted LangSmith on GCP – Docs by LangChain, https://docs.langchain.com/langsmith/gcp-self-hosted

- Self-hosted LangSmith on AWS – Docs by LangChain, https://docs.langchain.com/langsmith/aws-self-hosted

- Hybrid – Docs by LangChain, https://docs.langchain.com/langsmith/hybrid

- Self-hosted LangSmith – Docs by LangChain, https://docs.langchain.com/langsmith/self-hosted

- Create an Ingress for installations (Kubernetes) – Docs by LangChain, https://docs.langchain.com/langsmith/self-host-ingress

- Enable LangSmith Deployment – Docs by LangChain, https://docs.langchain.com/langsmith/deploy-self-hosted-full-platform